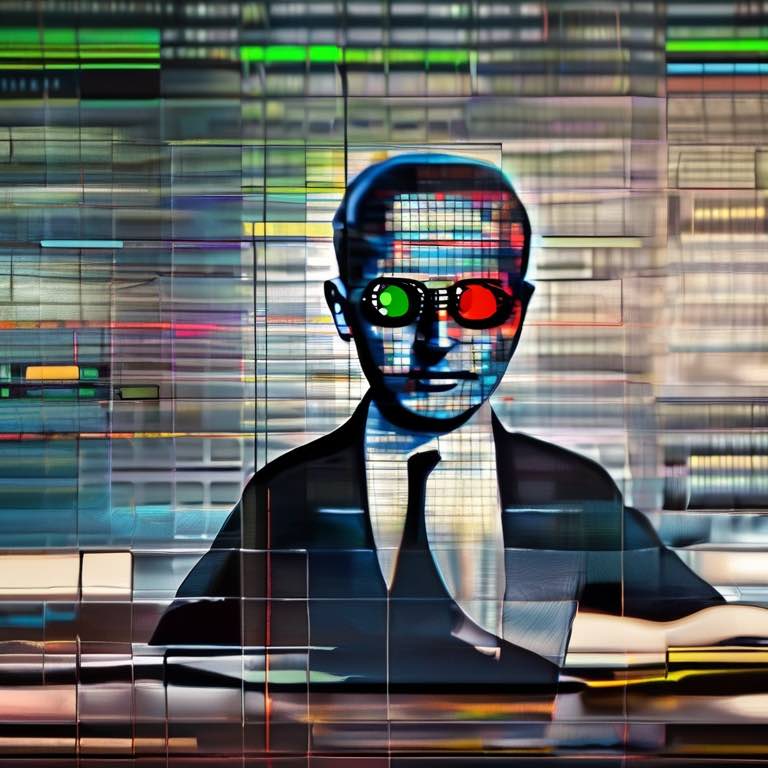

Deepfake, sử dụng công cụ AI để tạo ra video giả mạo hoặc bản ghi âm âm thanh rất thuyết phục, đặt ra thách thức đáng kể trong việc phân biệt nội dung thật từ giả mạo. Trong trường hợp này, những kẻ lừa đảo đã có thể mô phỏng một cách thuyết phục hình ảnh và giọng nói của các cá nhân mục tiêu sử dụng video và âm thanh có sẵn công khai, thuyết phục một nhân viên thực hiện 15 lần chuyển tiền tổng cộng 200 triệu đô la Hồng Kông vào năm tài khoản ngân hàng khác nhau tại Hồng Kông.

Sự cố này đã nâng cao mối quan tâm về việc sử dụng mới của công nghệ AI trong lừa đảo, với cảnh sát cung cấp lời khuyên để xác minh tính xác thực của cá nhân trong các cuộc gọi video. Các giải pháp như trang bị cho nhân viên một cặp khóa mã hóa để xác thực trong giao tiếp từ xa đang được xem xét để ngăn chặn các vụ lừa đảo tương tự trong tương lai. Cảnh sát Hồng Kông cũng dự định cải thiện hệ thống cảnh báo của mình đối với các giao dịch liên kết với các vụ lừa đảo đã biết, mở rộng phạm vi bao gồm một loạt các giao dịch điện tử và trực tiếp rộng lớn hơn.

Source: Arstechnica

Để giảm thiểu các mối đe dọa tiềm năng, điều quan trọng là cần thực hiện các biện pháp bảo mật mạng bổ sung với sự giúp đỡ của một đối tác đáng tin cậy như INFRA www.infrascan.net hoặc bạn cũng có thể tự thử bằng cách sử dụng check.website.